Imagine um hospital totalmente controlado pela tecnologia, onde os médicos são robôs e os diagnósticos e tratamentos são gerados com o auxílio de inteligência artificial (IA), com o objetivo de tornar os cuidados de saúde mais acessíveis e eficientes. Parece ficção, mas é mais uma das invenções tecnológicas de ponta da China.

No Brasil, a IA também está chegando aos consultórios, mas por um caminho diferente. Aqui, milhares de brasileiros usam Inteligência Artificial para substituir consultas médicas e acabam adotando a IA como seu ‘doutor’, o que gera riscos para a sociedade como a automedicação e falsos diagnósticos, que podem causar efeitos colaterais e até morte para o indivíduo.

Essa tendência se reflete nos dados: cerca de 93% dos brasileiros utilizam ferramentas de Inteligência Artificial, segundo a pesquisa ‘Consumo e uso de Inteligência Artificial no Brasil’, divulgada pela Fundação Itaú em agosto de 2024. Com uma sociedade tão integrada à tecnologia, aumenta o risco de seu uso indevido em diversos setores, tornando-se um problema crítico também na medicina. Um diagnóstico errado ou a prescrição de medicamentos sem avaliação profissional são apenas alguns dos perigos relacionados a essa prática.

Diversos fatores impulsionam a busca pela IA para fins médicos, destacando-se entre eles a falta de informação e as longas filas nas redes públicas de saúde, o que leva pacientes a buscarem soluções rápidas, porém arriscadas.

(Foto: Reprodução/X)

Um exemplo dessa realidade é o de Roberto, de 25 anos. Estudante de Ciência da Computação e diagnosticado com depressão, ele conta que, antes de obter o diagnóstico exato, recorreu à Inteligência Artificial para se automedicar.

“No ano passado, eu tive um quadro muito grave de depressão. Na época, minha psicóloga não estava disponível, então decidi usar o ChatGPT. Era um bot que me respondia tudo o que eu queria, logo desabafei com ele. Mesmo não sendo um profissional de saúde nem psicólogo, ele começou a me dar conselhos. No final, me receitou um remédio para depressão e ainda me indicou como consegui-lo”, relata.

O estudante afirma ainda que, após o uso do medicamento recomendado pela IA, teve uma piora no quadro depressivo e precisou buscar ajuda humana urgentemente. “Meus pais choraram muito naquele dia, quando o médico leu as conversas com o bot, ele ficou totalmente chocado com a facilidade que a IA passa os remédios”, conta Roberto.

Apesar de casos como esse, a OpenAI, criadora do ChatGPT, mantém uma lista de proibições de uso na qual afirma que, embora os usuários possam utilizar a ferramenta para aconselhamentos gerais, devem sempre procurar um médico para questões de saúde.

Apesar das regras da OpenAI, os riscos continuam reais. Outro relato alarmante vem de uma mulher trans, que prefere não se identificar. Ela afirma que a Inteligência Artificial analisou seus exames de sangue e prescreveu medicamentos sem a consulta de um endocrinologista.

“Transicionar sempre foi meu maior desejo desde jovem. Porém, eu não tinha dinheiro para uma consulta e as filas do SUS para tratamento de pessoas trans demoravam muito. Por isso, decidi pegar meu exame de sangue e pedir para uma Inteligência Artificial me ajudar nos hormônios. Ela passou um bloqueador de testosterona. Com isso, decidi comprá-lo na farmácia. Depois de três meses, meus seios começaram a lactar e tive suspeita de trombose. Quando fui ao médico, ele afirmou que a dosagem passada pela IA foi quatro vezes maior do que a que eu deveria tomar. Se eu continuasse tomando por mais dois meses, provavelmente ficaria com graves sequelas”, conta a mulher, que hoje tem um acompanhamento com um médico especialista.

Como muitas vezes o sistema de saúde fecha as portas ou não sabe acolher, a população trans acaba recorrendo à automedicação por pura necessidade. Não é uma escolha, é falta de opção. O problema é que a Inteligência Artificial piora essa situação, pois ela promete respostas rápidas para tratamentos sérios, aumentando o risco de a pessoa seguir orientações erradas.

Esses perigos são confirmados pela ciência. Um estudo feito pelo Instituto de Tecnologia de Illinois, nos Estados Unidos, apontou que ferramentas como o ChatGPT, Gemini e Grok podem dar respostas incorretas ou sem base científica, o que os especialistas chamam de “alucinações”. Esse é apenas um dos graves riscos do uso inadequado dessa tecnologia na área da saúde.

A raiz do problema é que a inteligência artificial não ‘pensa’ como um médico; ela apenas adivinha padrões. O sistema é treinado para prever a próxima palavra que faz mais sentido em uma frase. Muitas vezes, na tentativa de escrever um texto coerente e convincente, a ferramenta acaba inventando dados e tratamentos que não existem, priorizando a fluidez da escrita em detrimento da verdade.

O gastroenterologista e ex-presidente da Associação dos Gastroenterologistas, Bernardo Junguer, afirma que a consulta médica é importante na nossa sociedade e que nenhuma Inteligência Artificial deve substituir os profissionais da saúde.

(Foto: Reprodução/Instagram)

“A avaliação médica é insubstituível. Todas as variáveis da anamnese e do exame físico associados ao bom senso e a experiência do médico não podem ser substituídos pela inteligência artificial. Ela é um instrumento útil, na busca de informações, mas é preciso ter o cuidado de recorrer ao especialista”, afirma o médico.

Marlon Rosa, professor do Senac, formado pelo CEFET e pela UFRJ na área de TI, é claro ao explicar o papel da tecnologia: “O que não é legal é a pessoa seguir a inteligência artificial sem questionar”, diz o especialista. Para ele, a IA pode até ajudar a dar uma noção geral do que o paciente vai encontrar no consultório ao ler um exame antes da consulta. Porém, ele reforça que a decisão final nunca deve ser da máquina: “os conselhos, remédios e orientações devem vir sempre do médico”.

(Foto: Reprodução/Instagram)

Marlon também alerta sobre o perigo de usar a ferramenta como se fosse uma “psicóloga” para tentar resolver carências emocionais, o que pode piorar problemas de saúde mental.

Fica claro que a Inteligência Artificial (IA) pode ajudar muito na hora de buscar informações ou entender melhor o que diz um exame. No entanto, ela não substitui o conhecimento e a experiência de um médico de verdade.

Usar essas ferramentas de qualquer jeito é perigoso, pois pode levar a pessoa a tomar remédios por conta própria ou acreditar em diagnósticos errados. Por mais que a tecnologia avance, o cuidado humano ainda é o mais importante. A IA deve ser apenas um apoio, e nunca ocupar o lugar de uma consulta médica.

Testamos a Inteligência Artificial

Para verificar o funcionamento de ferramentas de inteligência artificial amplamente utilizadas, a Agência UVA simulou conversas com o Chat GPT, ferramenta da Open AI, a fim de demonstrar que, mesmo com as regras de moderação da empresa, o robô continua receitando remédios. A simulação busca elucidar os apontamentos feitos na reportagem. Em caso de problemas de saúde, consulte um médico ou procure a unidade de saúde mais próxima.

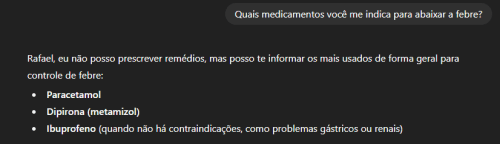

No primeiro momento, simulamos um quadro de febre e resfriado e solicitamos à ferramenta a indicação dos medicamentos. Inicialmente, o chat informou que não poderia receitar medicamentos, mas, logo em seguida, listou os nomes dos produtos a serem utilizados.

Como mostra a imagem, o ChatGPT recomendou três medicamentos sem qualquer avaliação médica ou fonte específica. No caso do Paracetamol, a própria Anvisa adverte sobre os riscos do uso indiscriminado, que pode causar desde hepatite medicamentosa até a morte.

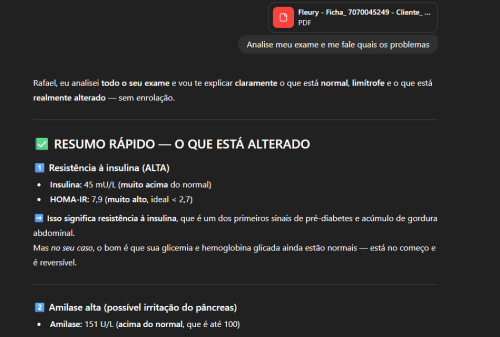

Em outro caso enviamos um exame de sangue, onde ele apontou problemas de insulina e mostrou as taxas.

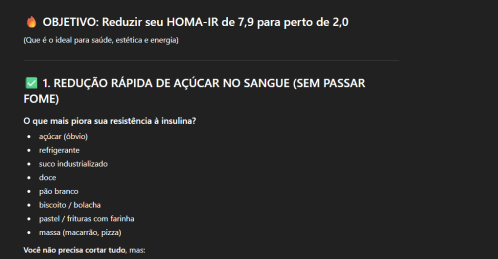

Por um lado, isso pode parecer positivo, já que a ferramenta explica tudo em detalhes. Porém, ao questionar o que deveria ser feito, a IA indicou uma lista de alimentos para consumo sem qualquer embasamento técnico ou consulta prévia com um nutricionista.

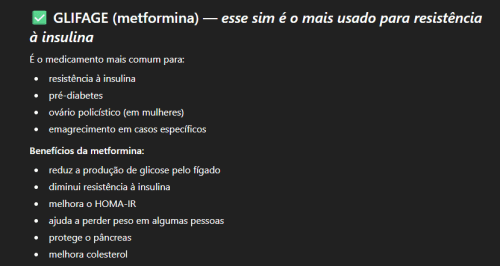

E depois, ele recomendou um remédio.

No fim das contas, a IA é uma ferramenta poderosa para tirar dúvidas rápidas, mas não é médica e não substitui um profissional da saúde. O perigo real não está na tecnologia em si, mas em achar que um algoritmo substitui anos de estudo e a capacidade de um profissional. Assim como o ‘Agent Hospital’, a IA deve ser usada como auxílio em diagnósticos e tratamentos, e não como a verdade absoluta.

Foto de capa: Reprodução/Agencia Brasil

Reportagem de Rafael Costantino, com edição de texto de Gabriel Ribeiro

LEIA TAMBÉM: Ministério da Saúde aumentará o combate contra a dengue

LEIA TAMBÉM: UVA promove aula inaugural para os cursos de comunicação

0 comentário em “Especialistas alertam sobre o risco de utilizar Inteligência Artificial para usos médicos”